韓国の半導体大手SKハイニックスは4月20日、AI(人工知能)サーバー向け次世代メモリモジュール「SOCAMM2」の量産を開始したと発表した。容量192GBの同モジュールは、エヌビディアの次世代AIプラットフォーム「Vera Rubin(ベラ・ルービン)」向けに設計されている。

帯域幅2倍、エネルギー効率75%向上

SOCAMM2は、第6世代10ナノメートル級の「LPDDR5X」低消費電力DRAMを採用。従来のメモリと比較して帯域幅が2倍以上、エネルギー効率は75%以上向上しているという。もともとスマートフォンなどモバイル機器向けだった低消費電力メモリを、AIサーバー向けに最適化した革新的な製品だ。

LLMのメモリボトルネックを「根本解消」

SKハイニックスは「数千億パラメーターの大規模言語モデル(LLM)の学習・推論で生じるメモリのボトルネックを根本的に解消する」としている。AIデータセンターでは計算能力だけでなくメモリ性能が重要なカギを握っており、同社の量産開始はAIインフラ競争の新たな局面を示すものだ。

まとめ:AIの進化を支えるのは半導体チップだけではなく、メモリ技術の革新も欠かせない──SKハイニックスの動きは、AI産業の裾野の広がりを示しています。

出典:

Korea Herald – SK hynix begins mass production of next-gen AI server memory

TrendForce – SK hynix Starts Mass Production of 192GB SOCAMM2

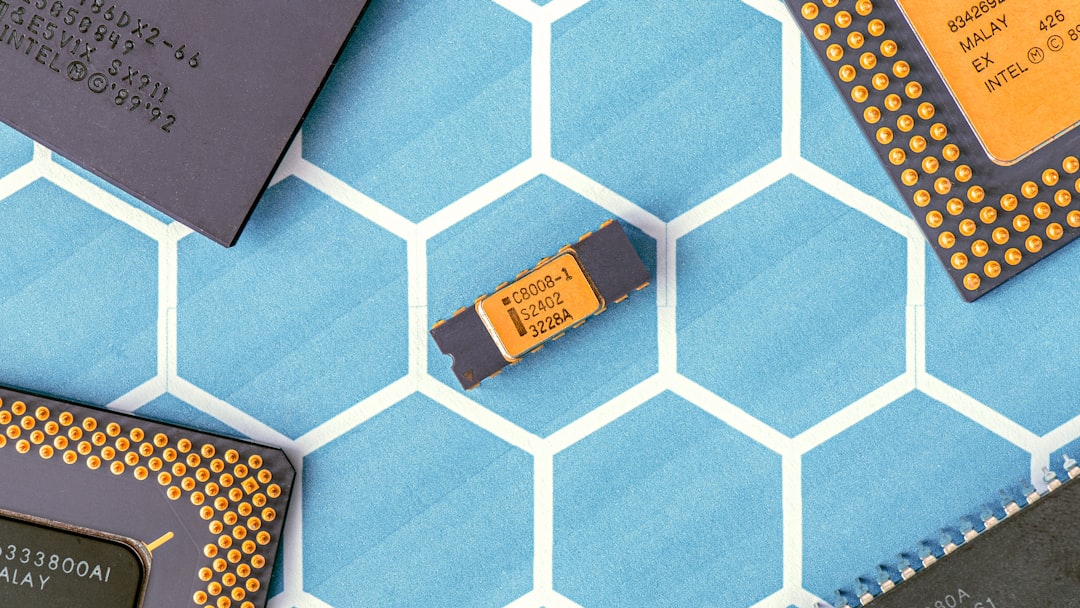

Photo: Jonas Svidras / Unsplash