グーグルが3月25日に発表したAIメモリ圧縮技術「TurboQuant」が、世界の半導体市場に衝撃を与えている。LLM(大規模言語モデル)の推論に必要なメモリ量を最大6分の1に削減できるこの技術により、AI向けメモリ需要の先行きに疑問符がついた形だ。

再学習不要の革新的な圧縮技術

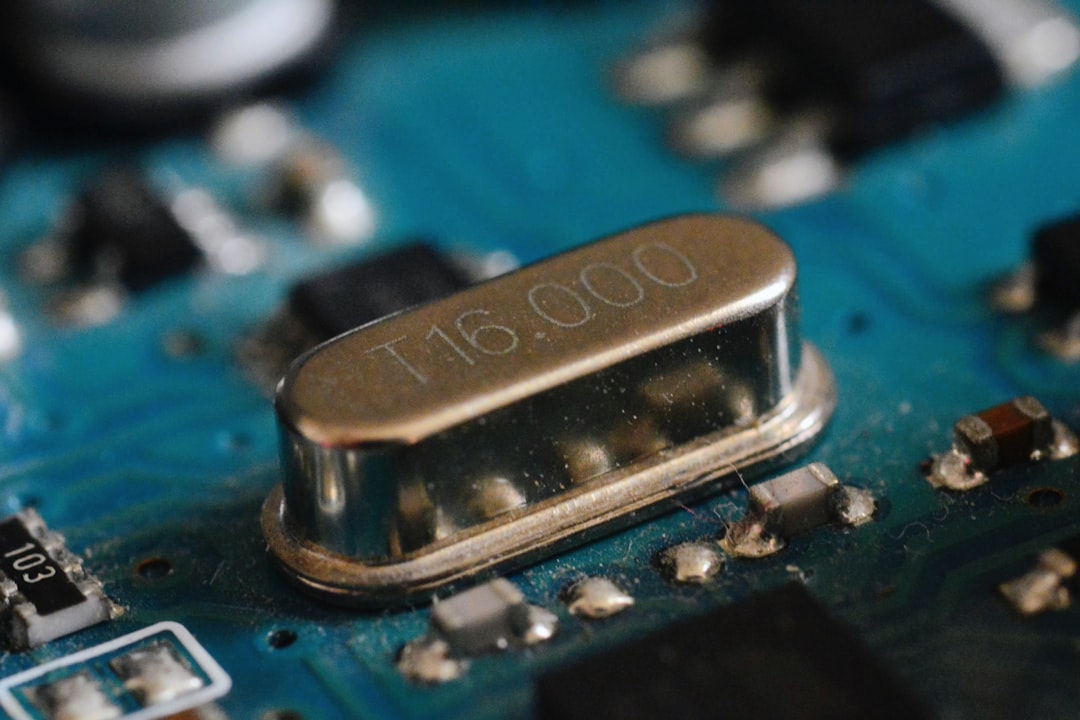

TurboQuantは、LLMの推論時に使われるキーバリューキャッシュ(過去の計算結果を保存する領域)を16ビットから約3ビットに圧縮する技術だ。エヌビディアのH100 GPU上では、注意機構(アテンション)の計算速度が最大8倍向上するという。再学習が不要な「ポストトレーニング量子化」手法であるため、既存のあらゆるLLMにすぐ適用できる点が市場に大きなインパクトを与えた。

メモリ半導体株に売りが集中

韓国市場では、SKハイニックスが6%安、サムスン電子が約5%安と大幅に下落。日本のキオクシアも約6%安、米マイクロンも前日に続き売られた。メモリ半導体各社はこの1年で株価が2倍から3倍に急騰しており、利益確定売りの口実を探していた投資家にとって格好の材料となった。

長期的にはプラスとの見方も

ただし、ウェルズ・ファーゴは「ジェヴォンズのパラドックス」を引用し、効率化がかえってAI利用の拡大と需要増加を招く可能性があると指摘している。韓国投資証券のアナリストも「メモリ容量と帯域幅の役割を混同した解釈ミスが売りを加速させた」と分析しており、過度な悲観論には警鐘を鳴らしている。

まとめ:短期的な売り圧力は避けられないが、AI市場全体の拡大が続く限り、メモリ需要の長期見通しは依然として明るいとの見方もある。

出典:

Digital Applied – Google TurboQuant: 6x LLM Memory Compression Guide

Meyka – Samsung and SK Hynix Stocks Dip as Google Unveils TurboQuant

Yahoo Finance – Chip Selloff Deepens After Google Touts Memory Breakthrough

Photo: Akshat Sharma / Unsplash